รายละเอียด Course ID: aic-01-04

ในยุคที่ Artificial Intelligence (AI) เข้ามามีบทบาทสำคัญในการขับเคลื่อนธุรกิจ หลายองค์กรเริ่มกังวลเรื่องความปลอดภัยและความเป็นส่วนตัวของข้อมูล (Data Privacy) เมื่อต้องส่งข้อมูลสำคัญไปประมวลผลบน Cloud API สาธารณะ หลักสูตรนี้จึงถูกออกแบบมาเพื่อแก้ปัญหานี้โดยเฉพาะ ด้วยการสอนสร้างระบบ "Local AI" ที่ทำงานได้ภายในเซิร์ฟเวอร์ขององค์กรเอง 100% ตั้งแต่ระบบสมองกล (Inference Engine) ไปจนถึงฐานข้อมูลความรู้ (Vector Database)

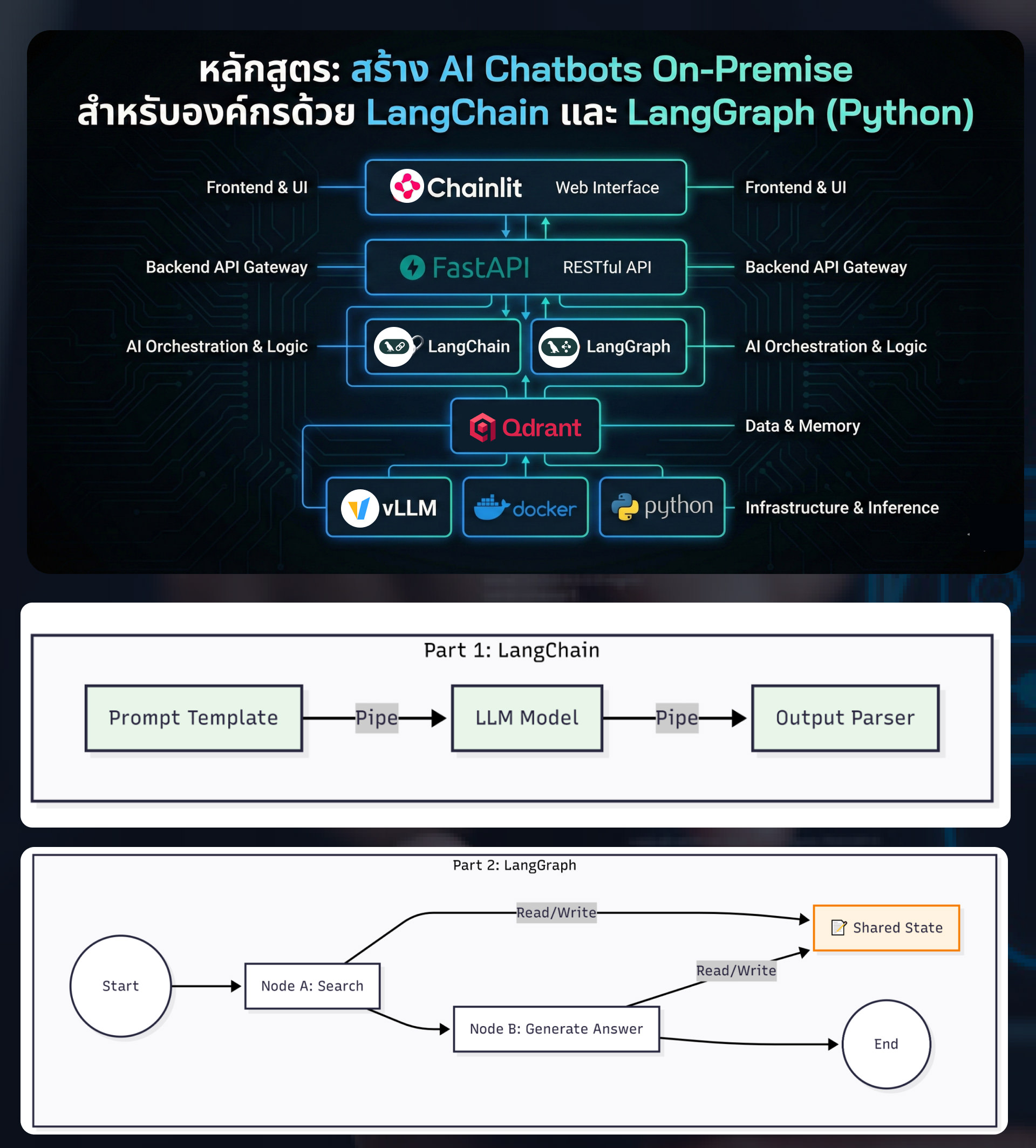

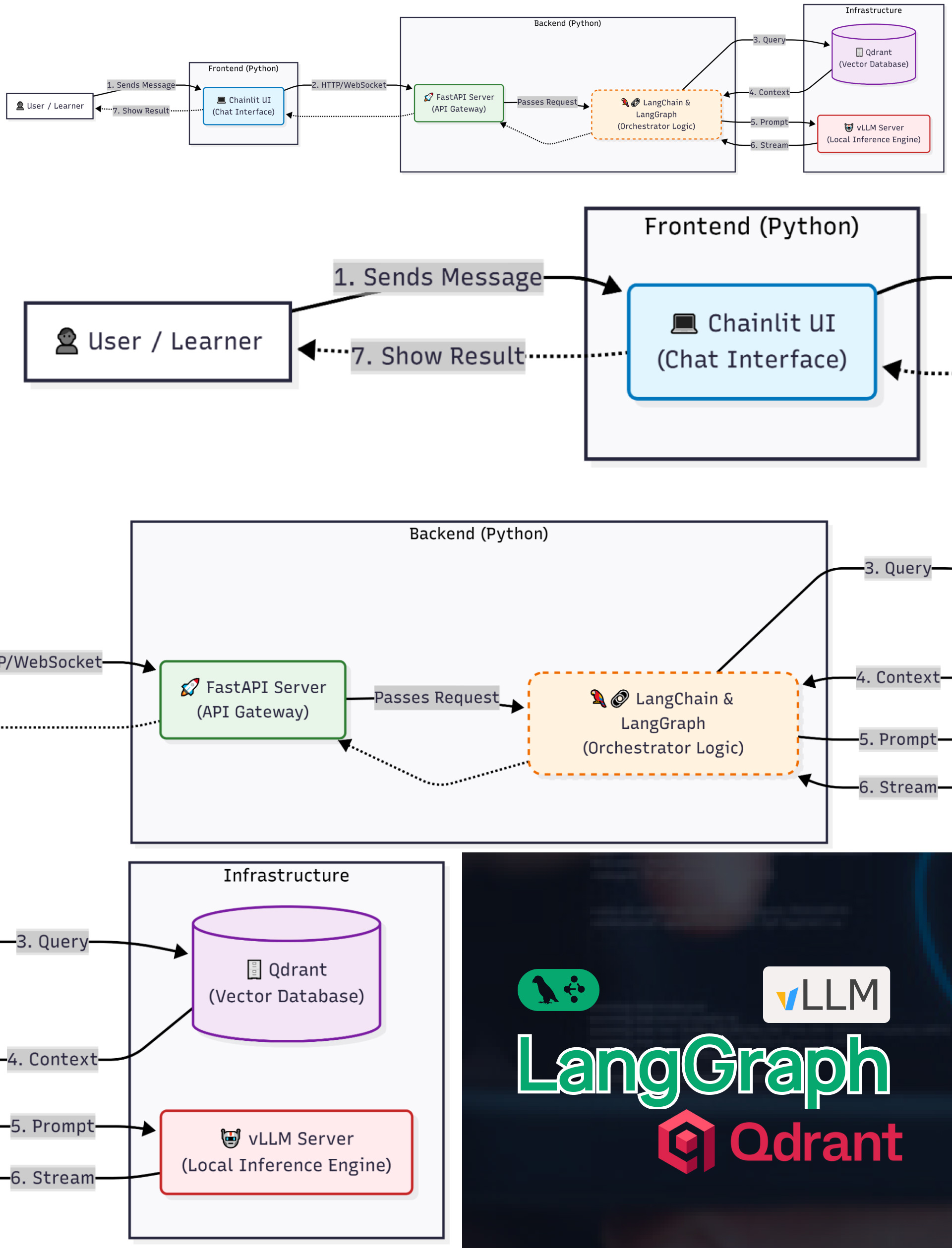

ผู้เรียนจะได้ลงมือปฏิบัติจริงในการพัฒนา AI Chatbot ที่มีความซับซ้อนระดับ Enterprise Grade โดยเปลี่ยนจากการเขียน Script ธรรมดา มาสู่การวางสถาปัตยกรรมแบบ Microservices ที่ยืดหยุ่นและขยายผลได้จริง เรียนรู้การใช้ vLLM เพื่อรันโมเดลภาษาขนาดใหญ่ให้ประมวลผลได้รวดเร็ว, การใช้ Qdrant จัดการความรู้เฉพาะทางขององค์กร (RAG), การใช้ LangGraph สร้าง Flow การตัดสินใจที่ชาญฉลาด แทนการเขียน Chain แบบเดิม และเชื่อมต่อระบบทั้งหมดผ่าน FastAPI และ Docker เพื่อให้พร้อมนำไปติดตั้งใช้งานจริง (Deployment) ได้ทันที

*** หมายเหตุ หลักสูตรนี้เน้นการใช้งาน LangChain และ LangGraph ร่วมกับ Python เพื่อสร้าง AI Chatbot ที่ทำงานได้ภายในองค์กรอย่างปลอดภัยและมีประสิทธิภาพ โดยใช้ Ollama, vLLM และ Qdrant เป็นเทคโนโลยีหลัก ผู้เรียน ไม่จำเป็น ต้องมีคอมพิวเตอร์ที่มี GPU ก็สามารถเรียนรู้ได้ผ่าน Google Colab (ฟรี)

สนใจเรียนหลักสูตรนี้? สั่งซื้อวิดีโอบันทึกการอบรมและเริ่มเรียนได้ทันที

ดูรายละเอียด & สั่งซื้อคอร์ส »

วิดีโอบันทึกการอบรม AI Chatbot On-Premise Python Stack

- Day 1: ความยาว 03:35:48

- Day 2: ความยาว 03:40:06

- Day 3: ความยาว 02:57:37

- Day 4: ความยาว 03:34:43

- Day 5: ความยาว 03:27:44

- Day 6: ความยาว 03:47:16

ความยาวรวม: 21 ชั่วโมง 13 นาที 20 วินาที

โปรโมชั่นราคาพิเศษ

ราคา 800 บาท

จากราคาเต็มปกติ 6,500 บาท

สำหรับท่านที่ต้องการซื้อในนามนิติบุคคล สามารถซื้อได้ในราคา 6,500 บาท (ยังไม่รวมภาษีมูลค่าเพิ่ม 7%)

การอบรมในหลักสูตรนี้เป็นการสอนสดออนไลน์ ผ่านโปรแกรม Zoom Meeting และมีการบันทึกการอบรมส่งให้ดูย้อนหลังทั้งหลักสูตร

กำหนดการอบรม

- วันที่ 19-23 มกราคม 2569 เวลา 20:00-23.00 น.

- อบรมรวม 5 วัน เฉลี่ยวันละ 3 ชั่วโมง

- ระยะเวลารวมทั้งหลักสูตร 15 ชั่วโมง

ภาพรวมหัวข้อการฝึกอบรม

- สถาปัตยกรรม Local AI vLLM และการจัดการ Infrastructure

- ฐานข้อมูลเวกเตอร์และระบบ RAG Vector Database & RAG Pipeline

- เรียนรู้ Qdrant (Vector DB)

- การสร้าง Agent Workflow ด้วย LangChain และ LangGraph

- พัฒนา Backend API ประสิทธิภาพสูงด้วย FastAPI

- Frontend ส่วนการแสดงผล ด้วย Chainlit (Python UI)

- เชื่อมต่อระบบทั้งหมดผ่าน Docker เพื่อการ Deploy ที่ง่ายและรวดเร็ว

แล้วผู้สอนเป็นใคร?

อ.สามิตร โกยม (สถาบันไอทีจีเนียส)

อ.สามิตร โกยม (สถาบันไอทีจีเนียส)

สวัสดีครับ ผมอาจารย์สามิตร โกยม - ผู้สอนหลักสูตรนี้ครับ ผมจบการศึกษาระดับปริญญาโทด้านเทคโนโลยีสารสนเทศ จากมหาวิทยาลัยพระจอมเกล้าพระนครเหนือ และอยู่ในวงการพัฒนาโปรแกรมและไอทีมากว่า 15 ปีแล้ว

- ประสบการณ์ทำงาน: เคยเป็นโปรแกรมเมอร์ในบริษัทเอกชน, ที่ปรึกษางานไอทีให้กับธุรกิจ SME หลายแห่ง และเป็น อาจารย์พิเศษ สอนวิชาคอมพิวเตอร์อยู่ที่มหาวิทยาลัยพระนครเหนือ (KMUTNB) ระหว่างปี 2557-2560

- ประสบการณ์สอน: ปัจจุบันผมเป็น CEO และผู้ก่อตั้งสถาบัน IT Genius Engineering และได้ถ่ายทอดความรู้ด้านการเขียนโปรแกรมและพัฒนาเว็บให้กับผู้เรียนกว่า หลายพันคน ตั้งแต่ระดับนักศึกษาไปจนถึงระดับองค์กร

- ความเชี่ยวชาญ: ผมสอนหลักสูตรด้าน Web Development, Programming และเทคโนโลยีใหม่ๆ มากมาย เช่น PHP, JavaScript, Python ตลอดจน ภาษาใหม่มาแรง อย่าง Rust ซึ่งผมตั้งใจผลักดันให้ผู้เรียนในไทยได้เรียนรู้ก่อนใคร

- ความมุ่งมั่น: เป้าหมายของผมคือการทำให้การเรียนรู้เทคโนโลยีที่ทันสมัย เป็นเรื่องง่ายและเป็นไปได้สำหรับทุกคน ดังนั้นคุณมั่นใจได้เลยว่าคุณจะได้รับการถ่ายทอดความรู้ด้วยวิธีที่เข้าใจง่าย เป็นกันเอง และนำไปใช้ได้จริง

ผู้เรียนต้องมีพื้นฐานอะไรบ้าง ?

- มีความรู้ภาษา Python เบื้องต้น

- เข้าใจคอนเซปต์ของ Web API (REST) เบื้องต้น

- เคยใช้งานคำสั่ง Docker พื้นฐาน (pull, run, ps)

- คอมพิวเตอร์ส่วนตัวสำหรับใช้ในการอบรม (Windows, macOS, หรือ Linux)

จุดเด่นของหลักสูตร

- เน้นสอนการใช้ Tech Stack ที่รันแบบ Offline ได้ทั้งหมด (Local LLM, Local Embeddings) ตัดความกังวลเรื่องข้อมูลรั่วไหล

- เปลี่ยนจาก LangChain Chains แบบเดิมที่ทำงานเป็นเส้นตรง มาสู่ LangGraph ที่รองรับการทำงานแบบ Loop และจดจำ Context ได้ดีกว่า (Stateful)

- สอนใช้ vLLM ซึ่งเป็น Inference Engine ที่เร็วที่สุดในปัจจุบัน และ FastAPI ที่เป็นมาตรฐานของ Python Backend

- เรียนรู้วิธีแยกส่วน Frontend (Chainlit), Backend (FastAPI) และ Database (Qdrant) ออกจากกัน เพื่อความง่ายในการดูแลรักษา

- ทุก Workshop รันบน Docker Environment จำลองสภาพแวดล้อมการทำงานจริงในระดับองค์กร

วัตถุประสงค์ของหลักสูตร

- เพื่อให้ผู้เรียนเข้าใจสถาปัตยกรรมและสามารถติดตั้งระบบ Local AI (vLLM & Embedding) บน Infrastructure ของตนเองได้

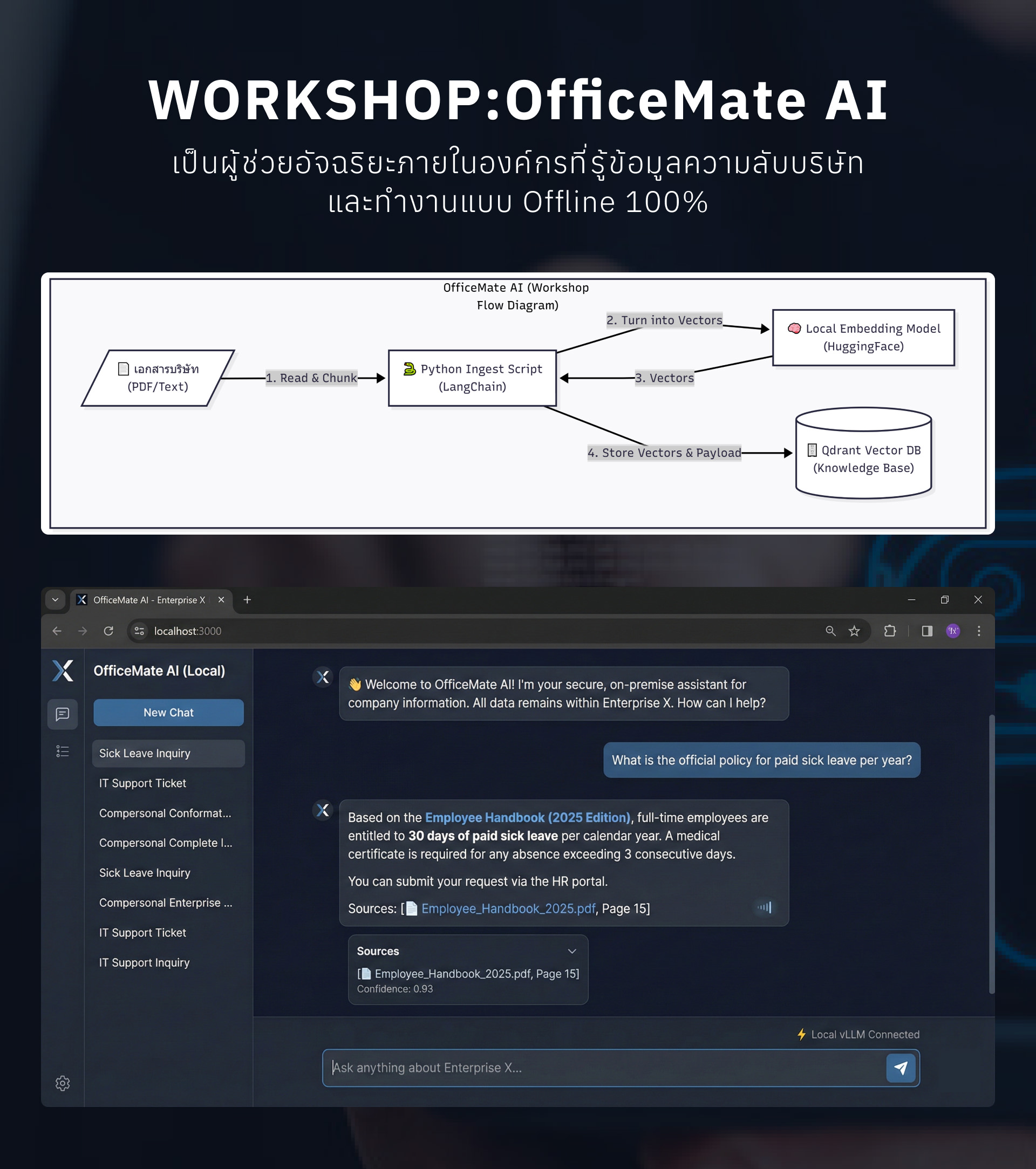

- เพื่อให้ผู้เรียนสามารถสร้างระบบ RAG (Retrieval-Augmented Generation) เพื่อให้ AI ตอบคำถามจากเอกสารภายในองค์กรได้อย่างแม่นยำ

- เพื่อให้ผู้เรียนสามารถใช้งาน LangGraph ในการจัดการ State และ Logic ของ Chatbot ที่ซับซ้อน (Agentic Workflow) ได้

- เพื่อให้ผู้เรียนสามารถพัฒนา RESTful API ด้วย FastAPI เพื่อเชื่อมต่อ AI กับแอปพลิเคชันภายนอกได้

- เพื่อให้ผู้เรียนสามารถ Deploy ระบบทั้งหมดด้วย Docker Compose ได้อย่างถูกต้องตามหลัก Best Practices

หลักสูตรนี้เหมาะกับใคร?

- Software Developers / AI Engineers ที่ต้องการย้ายจาก OpenAI API มาทำระบบเอง (Self-hosted)

- Web Developers (Frontend/Full-stack) ที่ต้องการเพิ่มทักษะด้าน AI และ LLMs เข้าไปในสายงาน

- Data Scientists ที่ต้องการ Deploy โมเดลให้เป็น Application

- Solution Architects หรือ Tech Leads ที่ต้องการเข้าใจกระบวนการสร้าง AI Chatbot เพื่อนำไปประยุกต์ใช้กับระบบขององค์กร

- ผู้ที่สนใจสร้าง Product AI และต้องการเรียนรู้ Tech Stack ที่ทันสมัยและครบวงจร

- IT Infrastructure / DevOps ที่ต้องการเข้าใจการวางระบบ AI Server ในองค์กร

คอมพิวเตอร์และโปรแกรมที่รองรับการพัฒนา

- รองรับ Windows 10, 11

- รองรับ MacOS

- รองรับ Linux OS

รอบการเปิดอบรม

อบรมออนไลน์ (สอนสด)

- 19 - 23 มกราคม 2026

วิทยากรผู้สอน

ระยะเวลาในการอบรม

- 21 ชั่วโมง

ภาพรวมหัวข้อการอบรม

เนื้อหาการอบรม

รายละเอียดหลักสูตร

Day 1: ปูพื้นฐาน Local AI Infrastructure และ vLLM

- On-Premise AI Overview: ทำความเข้าใจความแตกต่างระหว่าง Cloud AI กับ Local AI และทำไมองค์กรถึงต้องการ Privacy

- รู้จัก vLLM (Inference Engine): เจาะลึกเครื่องมือรันโมเดลภาษาที่เร็วที่สุดในปัจจุบัน และสถาปัตยกรรม PagedAttention

- Environment Setup with Docker: การติดตั้ง Docker, NVIDIA Container Toolkit และเตรียม Python Virtual Environment

- Running Local LLM: เวิร์กชอปการรันโมเดล Open Source (เช่น Llama-3, Qwen, Typhoon) ผ่าน vLLM บนเครื่องตัวเอง

- LangChain Integration: การเขียน Python เพื่อเชื่อมต่อ vLLM ผ่าน OpenAI Compatible API

Day 2: สร้างสมองความจำด้วย Vector Database และ RAG

- RAG Architecture 101: เข้าใจกระบวนการ Retrieval-Augmented Generation เพื่อลดอาการ Hallucination ของ AI

- Vector Embeddings: หลักการแปลงข้อความภาษาไทยเป็นตัวเลข (Vector) และการเลือก Embedding Model (HuggingFace)

- Setting up Qdrant: การติดตั้งและบริหารจัดการ Qdrant Vector Database ผ่าน Docker Compose

- Data Ingestion Pipeline: เขียน Script อ่านไฟล์เอกสารองค์กร (PDF/Text) ตัดคำ (Chunking) และบันทึกลงฐานข้อมูล

- Similarity Search: เทคนิคการเขียน Query เพื่อค้นหาข้อมูลที่เกี่ยวข้องจาก Qdrant มาใช้งาน

Day 3: ยกระดับสู่ AI Agent ด้วย LangGraph

- Why LangGraph?: ข้อจำกัดของ LangChain แบบเดิม (Chains) และการเปลี่ยนผ่านสู่การทำงานแบบ Graph (Cyclic)

- Core Concepts: ทำความเข้าใจ Nodes (จุดทำงาน), Edges (เส้นเชื่อม), และ State (หน่วยความจำกลาง)

- Building Graph Workflow: เวิร์กชอปสร้าง Flow การทำงาน: รับคำถาม -> ค้นหาข้อมูล (Retrieve) -> สรุปคำตอบ (Generate)

- Agent State Management: การออกแบบโครงสร้างข้อมูลเพื่อเก็บ Chat History และ Context ระหว่างการสนทนา

- Visualizing the Graph: การ Compile และแสดงภาพ Diagram การทำงานของ Agent เพื่อ Debug Logic

Day 4: พัฒนา Backend API มาตรฐานองค์กรด้วย FastAPI

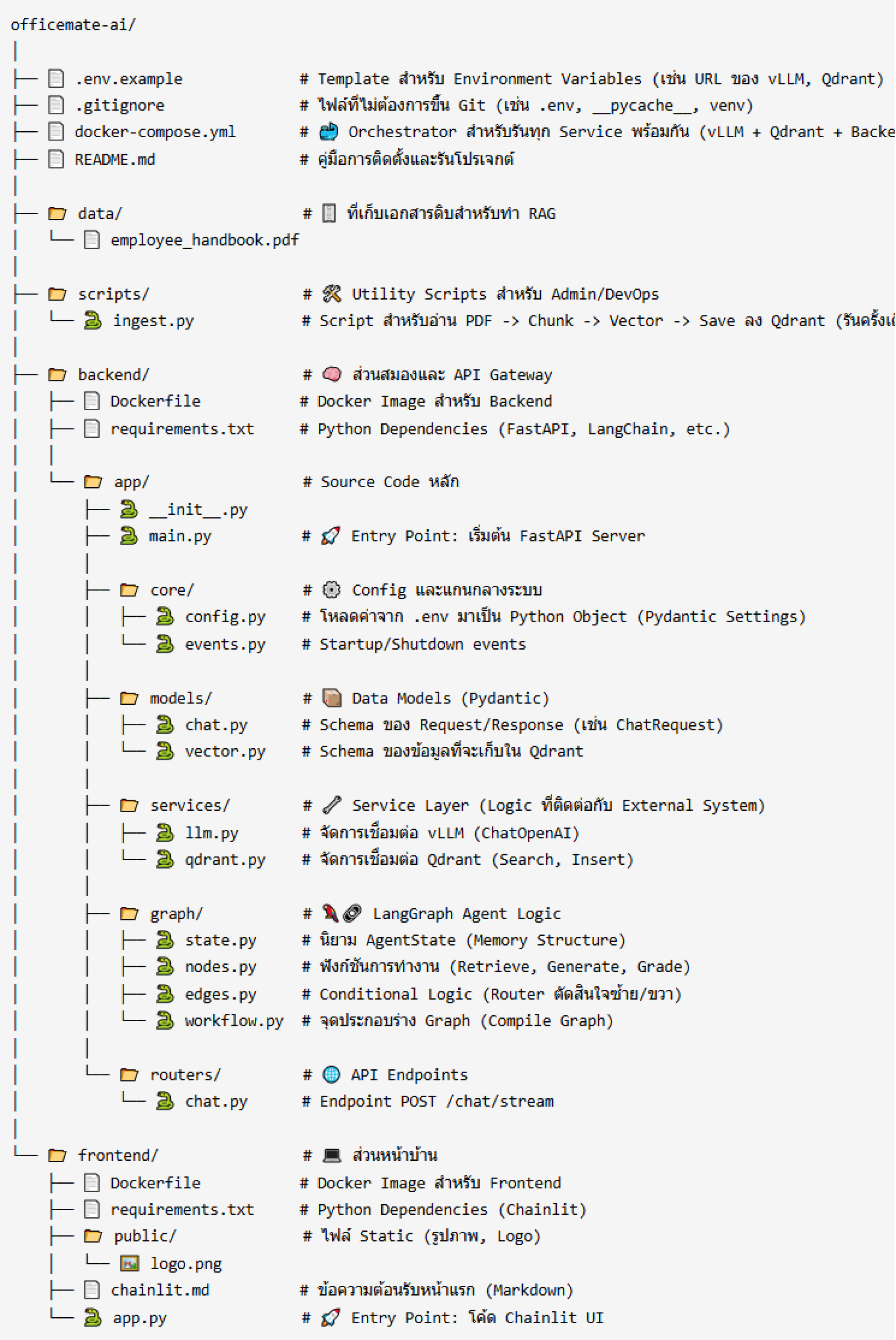

- Microservices Design: การออกแบบโครงสร้างโปรเจกต์แบบแยกส่วน (Decoupled Architecture) เพื่อการขยายตัวในอนาคต

- FastAPI Implementation: การสร้าง RESTful API Endpoint เพื่อรับ-ส่งข้อความกับ LangGraph

- Asynchronous Programming: เทคนิคการเขียน Python แบบ Async/Await เพื่อรองรับผู้ใช้งานจำนวนมากพร้อมกัน

- Streaming Response (SSE): การทำ Server-Sent Events เพื่อส่งข้อความตอบกลับทีละตัวอักษร (Token Streaming) แบบ Real-time

- API Documentation: การจัดการ Swagger UI เพื่อให้ทีม Frontend หรือ Mobile นำ API ไปใช้งานต่อได้ง่าย

Day 5: เชื่อมต่อ Frontend และ Deployment (Production Ready)

- Introduction to Chainlit: รู้จัก Python Framework สำหรับสร้าง Chat Interface สวยงามโดยไม่ต้องเขียน HTML/CSS

- Frontend Integration: การเชื่อมต่อ Chainlit UI เข้ากับ FastAPI Backend แบบ Streaming

- Full Stack Docker Compose: การมัดรวมทุก Service (vLLM, Qdrant, Backend, Frontend) ในไฟล์ docker-compose.yml เดียว

- End-to-End Testing: ทดสอบระบบจำลองสถานการณ์จริง ตั้งแต่ User พิมพ์ถาม จนถึง AI ค้นข้อมูลและตอบกลับ

- Deployment & Scaling: แนวทางการนำไปติดตั้งบน Server องค์กร และเทคนิคการขยาย Scaling เมื่อ User เพิ่มขึ้น

Workshop AI Chatbots On-Premise ด้วย LangChain และ LangGraph (Python) สำหรับองค์กร